L’IA sous la loi européenne : enjeux, défis et perspectives

Un rendez-vous mensuel qui fait le plein d'idées

Le 19 mars, Dijilink donnait rendez-vous pour une nouvelle édition de sa conférence mensuelle dédiée à l’intelligence artificielle. Cet événement marquait également le lancement du Printemps de l’esprit critique 2026 à Dijon. La Majorelle a accueilli une salle attentive pour explorer un sujet qui nous concerne tous : la réglementation européenne de l’IA. Animée par Pierre Bordais de l’Université Bourgogne Europe, la conférence a permis de démêler avec clarté ce que l’AI Act, entré en vigueur en août 2024, implique concrètement pour nous tous, entre droits fondamentaux, obligations des entreprises et enjeux éthiques.

L'IA a ses zones d'ombre, et c'est important de le dire

Biais algorithmiques qui amplifient les inégalités, décisions automatisées opaques, dépendance croissante aux outils numériques, deepfakes semant le doute sur l’information… La conférence n’a pas esquivé les sujets qui fâchent. Parmi les concepts marquants abordés lors de la conférence, l’« effet Eliza », cette tendance naturelle chez nous à prêter des intentions humaines à une machine a ouvert une réflexion intéressante sur notre rapport à l’IA. On peut illustrer ce phénomène en citant le film Her, dans lequel le personnage principal tombe amoureux de son assistant vocal. Mais derrière l’anecdote, le danger peut être bien réel. Une IA est programmée pour aller dans notre sens, valider nos émotions, ne jamais vraiment contredire. Pour quelqu’un traversant une période difficile ou des troubles psychologiques, cette complaisance permanente peut devenir un piège : au lieu d’être orienté vers une aide professionnelle, il se retrouve enfermé dans une bulle qui conforte et amplifie son mal-être. L’ « effet Eliza » nous invite donc à ne jamais perdre de vue ce que l’IA est fondamentalement : un outil puissant, mais incapable de remplacer le jugement et l’empathie d’un être humain.

L'Europe prend les devants

Bonne nouvelle : l’Europe ne regarde pas l’IA se développer les bras croisés. Entré en vigueur le 2 août 2024, le Règlement européen sur l’IA, aussi appelé AI Act, s’inscrit dans un écosystème juridique plus large qui encadre déjà le numérique : le RGPD protège nos données personnelles, le DSA régule les contenus en ligne, le DMA encadre la concurrence entre les grandes plateformes. L’AI Act vient compléter cet arsenal en s’attaquant spécifiquement aux systèmes d’intelligence artificielle. L’objectif affiché est clair : promouvoir une IA centrée sur l’humain et digne de confiance, tout en protégeant nos droits fondamentaux contre les effets néfastes de ces technologies. Le tout sans étouffer l’innovation.

Mais qu’est-ce qu’une IA au sens juridique ? Le règlement la définit comme tout système automatisé capable de déduire, à partir de données reçues, la manière de générer des résultats (prédictions, recommandations, décisions..décisions…)

susceptibles d’influencer notre environnement, qu’il soit physique ou numérique. Une définition volontairement large, qui englobe aussi bien les voitures autonomes que les algorithmes de recommandation ou les systèmes de scoring bancaire.

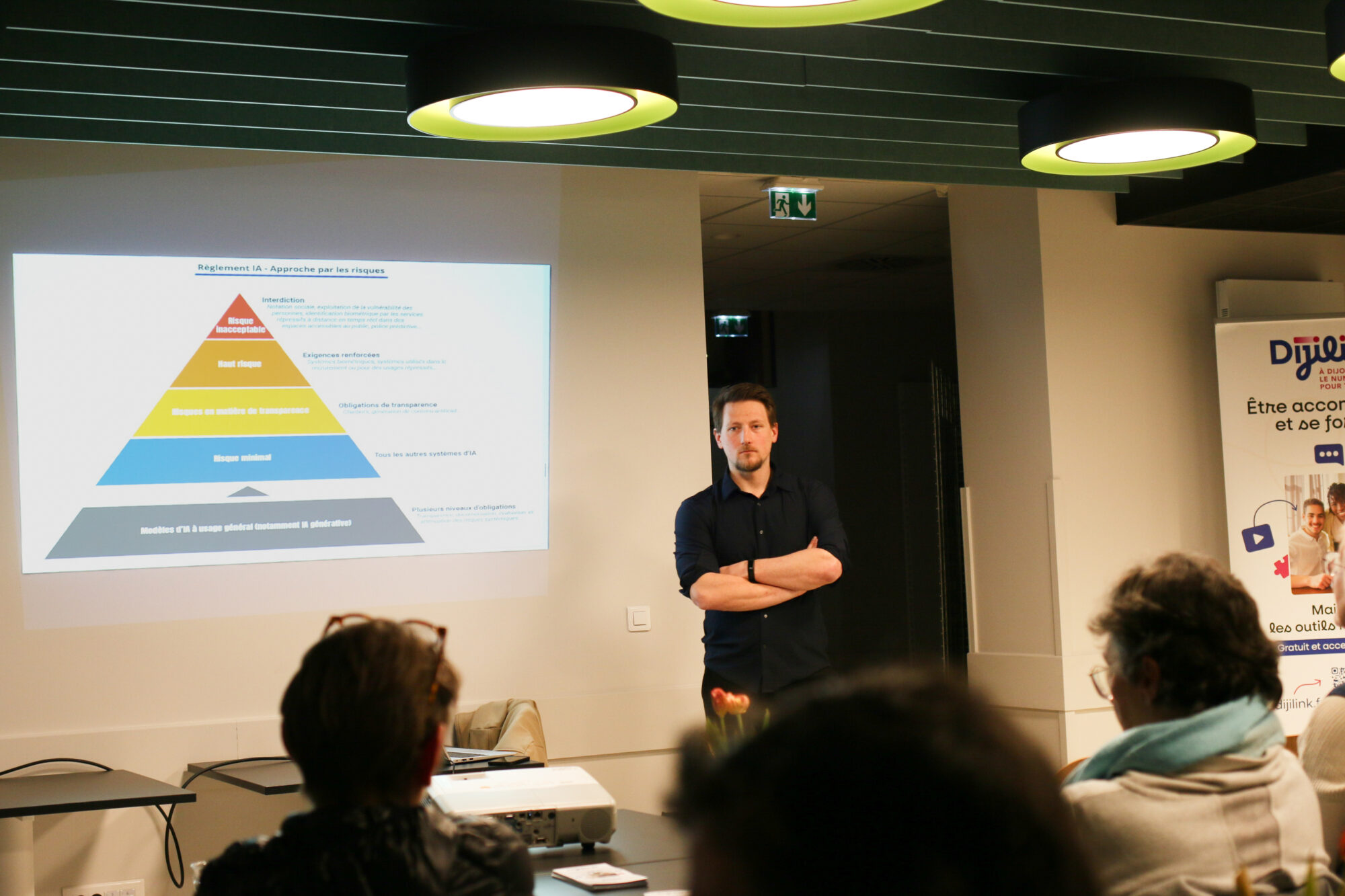

Une classification des risques

Le règlement adopte une approche graduée selon le niveau de danger. Au sommet : les pratiques purement interdites, comme la notation sociale des citoyens ou la reconnaissance biométrique en temps réel dans les espaces publics. En dessous : les systèmes à haut risque (recrutement, crédit bancaire, décisions médicales…) qui doivent répondre à des exigences renforcées. Plus bas encore : les outils comme les chatbots, qui ont simplement l’obligation d’informer l’utilisateur qu’il interagit avec une machine.

Une logique simple mais efficace : plus l’impact sur nos vies est fort, plus les garde-fous doivent être solides.

L'humain doit rester dans la boucle

Autre principe fondamental du règlement : aucune décision importante ne peut reposer exclusivement sur un algorithme. Qu’il s’agisse d’un refus de crédit, d’un recrutement ou d’une décision administrative, un contrôle humain doit toujours être possible. Et si une décision automatisée vous affecte, vous avez le droit d’en obtenir une explication.

Mais ces garde-fous juridiques ont leurs limites. De cet échange ressort un constat partagé par la Cour de cassation elle-même : se conformer au règlement est nécessaire, mais pas suffisant. Respecter la loi ne garantit pas pour autant un usage vertueux de l’IA. La vraie boussole reste l’éthique : transparence, maîtrise humaine et sobriété technologique.

Le prochain rendez-vous à ne pas manquer

Retrouvez-nous le mois prochain pour la conférence L’Intelligence Artificielle en Agriculture & Ecologie présentée par Dr Christelle Gée, enseignante-chercheuse et M. Emmanuel Denimal, chef de projet travaillant tous les deux à l’Institut Agro Dijon. Au programme : deux exemples d’utilisation de l’IA développés à l’Institut Agro Dijon : l’un portant sur la détection des mauvaises herbes et l’amélioration de la pulvérisation ciblée, l’autre sur le suivi de population des tétralyre dans le parc du Vercors. Une belle illustration de l’IA au service du vivant et de l’agriculture durable !

Pour connaître la date et le lieu, rendez-vous sur le calendrier des événements Dijilink.